Découvrez la précision de l’IA de transcription d’Apple, qui révolutionne la manière dont nous traitons les conversations. Avec des avancées significatives depuis son lancement, cette technologie promet une amélioration notable dans l’accessibilité et la productivité. Plongez dans les détails de cette innovation marquante dans le monde numérique.

Précision de l’IA de transcription d’Apple

Récemment, Apple a fait parler d’elle avec sa nouvelle API de transcription, qui a été testée face à d’autres outils populaires de transcription. Bien que Whisper d’OpenAI soit un modèle reconnu, Apple a mis en avant la rapidité de son nouveau service. Mais quelle est vraiment sa précision ? Nous avons mené des tests pour le découvrir.

Le développeur Prakash Pax a réalisé des essais intéressants avec sa propre méthodologie. Il a enregistré 15 échantillons audio en anglais, variant de 15 secondes à 2 minutes, et les a comparés à trois outils de reconnaissance vocale :

- Les nouvelles API de transcription d’Apple

- Whisper Large v3 Turbo d’OpenAI

- Scribe v1 d’Eleven Labs

Bien que je ne puisse pas inclure ses résultats spécifiques, il a mentionné qu’étant un locuteur non natif, ses résultats pourraient varier pour d’autres utilisateurs. Cela a éveillé ma curiosité sur la façon dont Apple et OpenAI se mesureraient à l’outil Parakeet de NVIDIA, qui est réputé pour sa rapidité.

Méthodologie des tests

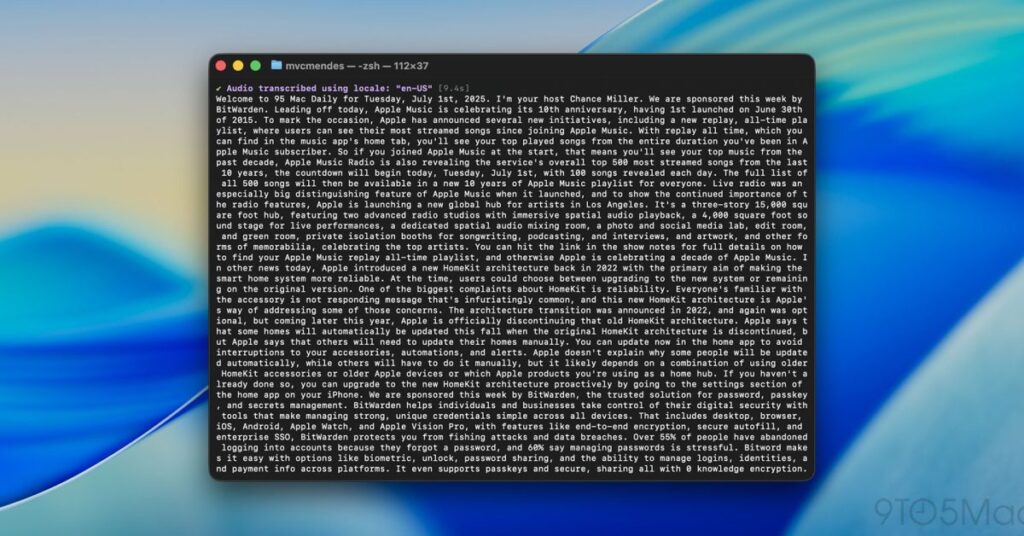

Pour mes propres tests, j’ai choisi un épisode récent de 9to5Mac Daily d’une durée de 7:31. J’ai utilisé MacWhisper pour exécuter Whisper et Parakeet, tandis que pour l’API de transcription d’Apple, j’ai utilisé le projet Yap de Finn Vorhees. Tous les tests ont été réalisés sur un MacBook Pro M2 Pro avec 16 Go de RAM.

Pour analyser les taux d’erreur, j’ai utilisé les espaces Hugging Face pour les métriques de taux d’erreur de caractère (CER) et de taux d’erreur de mot (WER). Ces deux outils expliquent leur méthodologie, garantissant que tous les modèles sont évalués de manière cohérente.

Résultats des tests

| Modèle | Temps de transcription | Taux d’erreur de caractère | Taux d’erreur de mot |

| Parakeet v2 | 2 secondes | 5.8% | 12.3% |

| Whisper Large V3 Turbo | 40 secondes | 0.2% | 1.5% |

| Apple | 9 secondes | 1.9% | 10.3% |

Ensuite, j’ai demandé à ChatGPT, Claude, et Gemini d’évaluer également les taux d’erreur. Voici les résultats :

ChatGPT (o4-mini-high)

| Modèle | Temps de transcription | Taux d’erreur de caractère | Taux d’erreur de mot |

| Parakeet v2 | 2 secondes | 6.0% | 12.3% |

| Whisper Large V3 Turbo | 40 secondes | 0.4% | 1.4% |

| Apple | 9 secondes | 2.1% | 10.2% |

Claude (Sonnet 4)

| Modèle | Temps de transcription | Taux d’erreur de caractère | Taux d’erreur de mot |

| Parakeet v2 | 2 secondes | 8.4% | 11.0% |

| Whisper Large V3 Turbo | 40 secondes | 0.1% | 1.0% |

| Apple | 9 secondes | 3.5% | 8.2% |

Gemini (2.5 Pro)

| Modèle | Temps de transcription | Taux d’erreur de caractère | Taux d’erreur de mot |

| Parakeet v2 | 2 secondes | 7.6% | 12.3% |

| Whisper Large V3 Turbo | 40 secondes | 0.3% | 0.4% |

| Apple | 9 secondes | 3.4% | 5.3% |

Comparaison des modèles de transcription

La question de savoir quel est le meilleur modèle dépend des besoins spécifiques de l’utilisateur. Whisper se distingue clairement par sa précision, mais sa lenteur peut poser problème pour des projets nécessitant une transcription rapide. Parakeet, quant à lui, est le choix idéal pour ceux qui privilégient la rapidité, même si cela se fait au détriment de la précision.

Le modèle d’Apple se positionne à mi-chemin entre ces deux extrêmes. Bien qu’il soit plus rapide que Whisper, il offre une précision qui le place en compétition avec Parakeet. Cela représente une avancée significative pour Apple dans le domaine de la transcription.

Bien que le modèle d’Apple n’atteigne pas encore le niveau de Whisper pour des travaux critiques nécessitant une précision absolue, la possibilité d’une exécution native sans dépendance à des API tierces est un atout majeur. À mesure que l’adoption par les développeurs augmente et qu’Apple continue d’améliorer son API, nous pouvons nous attendre à des progrès notables.

Pour en savoir plus sur les technologies de transcription, consultez le site TechCrunch.

Qu’est-ce que l’API de transcription d’Apple ?

L’API de transcription d’Apple est un nouvel outil qui permet de convertir la parole en texte de manière rapide et précise, surpassant d’autres modèles comme Whisper.

Comment fonctionne l’API de transcription d’Apple ?

L’API utilise des algorithmes avancés pour analyser des échantillons audio et produire une transcription en temps réel, optimisée pour les performances sur les appareils Apple.

Quelle est la précision de l’API de transcription ?

Bien que l’API d’Apple soit moins précise que le modèle Whisper, elle offre une bonne précision avec un taux d’erreur de 1,9 % pour le taux d’erreur de caractères.

Quels sont les avantages de l’API de transcription d’Apple par rapport à d’autres outils ?

En plus de sa rapidité, l’API d’Apple fonctionne nativement sans dépendance à des API tierces, ce qui facilite son intégration et son utilisation dans divers projets.